Назад

О важности исследования свойств робастности и безопасности моделей машинного обучения

Инновационные исследования позволяют нам создавать ИИ-решения, которые превосходят ожидания, обеспечивая нашим клиентам конкурентное преимущество и безопасность их бизнеса

Исследование робастности, безопасности и интерпретируемости моделей машинного обучения становится все более важным по мере того, как эти технологии все шире внедряются в различные сферы нашей жизни. Количество научных статей на данную тематику превысило в 2024 году 10 тысяч. Если ранее основной интерес к этой теме наблюдался среди исследователей, то теперь вопросы безопасности нейронных сетей уже массово стали проникать и в индустрию. Давайте рассмотрим, почему это так критично и в каких областях особенно необходимо уделять внимание этим аспектам.

Робастность моделей машинного обучения

Под робастностью моделей в контексте машинного обучения имеется в виду способность модели сохранять стабильную производительность при наличии шума и небольших изменений во входных данных, при работе с данными, отличающимися от тех, на которых модель была обучена, а также при работе с данными, распределение которых меняется со временем.

Среди свойств, которыми должна обладать качественная модель машинного обучения в контексте робастности можно выделить:

Устойчивость к шуму и небольшим отклонениям:

Модель должна корректно работать даже при наличии случайных ошибок или неточностей в данных.

Важно для работы с реальными данными, которые часто содержат погрешности измерений или ошибки ввода.

Обобщающая способность:

Способность модели эффективно работать на новых, ранее не виденных данных.

Критично для применения моделей в динамичных средах.

Стабильность при смещении распределения данных:

Способность модели адаптироваться к постепенным изменениям в распределении данных со временем.

Ключевой фактор для долгосрочного использования моделей в реальных условиях.

Безопасность моделей машинного обучения

Безопасность моделей машинного обучения относится к их способности противостоять вредоносным атакам, манипуляциям и неправильному использованию, а также к обеспечению конфиденциальности данных и этичности применения.

Безопасный и надежный искусственный интеллект должен учитывать следующие аспекты:

Защита от атак:

Противостояние попыткам обмануть или манипулировать моделью.

Сохранение стабильности при целенаправленных атаках.

Интерпретируемость:

Возможность объяснить результат работы модели на понятном человеку языке.

Играет большую роль для областей, где на основании работы нейронных сетей могут приниматься важные решения

Конфиденциальность данных:

Защита личной информации, используемой для обучения и инференса.

Предотвращение утечек конфиденциальных данных через модель.

Этичность и справедливость:

Обеспечение непредвзятости модели.

Предотвращение дискриминации и несправедливых решений.

Практические области, где робастность и безопасность особенно важны

Медицина

Искусственный интеллект находит широкое применение в медицине, трансформируя многие аспекты здравоохранения. Среди его применений можно выделить:

Диагностика заболеваний: анализ медицинских изображений (рентген, МРТ, КТ, УЗИ) и помощь в постановке диагноза на основе симптомов и медицинской истории

Мониторинг состояния пациентов: анализ данных с носимых устройств в реальном времени

Предиктивная аналитика: прогнозирование вспышек заболеваний, оценка рисков развития заболеваний у пациентов, предсказание результатов лечения и т.д.

Внимание к вопросам робастности и безопасности в медицинском ИИ должно уделяться по следующим причинвм:

Критичность решений. Медицинские решения напрямую влияют на здоровье и жизнь пациентов. Ошибки могут привести к серьезным последствиям, включая неправильное лечение или отсутствие необходимого лечения.

Разнообразие данных. Медицинские данные часто неоднородны и могут значительно различаться между популяциями. Модели должны быть устойчивы к вариациям в данных.

Конфиденциальность. Медицинские данные являются строго конфиденциальными. Утечка или неправильное использование таких данных может иметь серьезные правовые и этические последствия.

Доверие медицинского сообщества. Врачи и пациенты должны доверять ИИ-системам для их широкого внедрения. Для этого данные системы должны быть безопасными и интерпретируемыми.

Финансы

Применение искусственного интеллекта (ИИ) в финансовом секторе стремительно растет, трансформируя традиционные подходы к управлению финансами, инвестициям и рискам. Рассмотрим основные области применения ИИ в финансах и причины важности безопасности и робастности в этой сфере.

Алгоритмическая торговля: автоматическое выполнение сделок на основе анализа рыночных данных и высокочастотная торговля. Уязвимые системы машинного обучения в финансах способны привести к серьезным экономическим последствиям для того, кто внедрил эти модели.

Оценка кредитоспособности: анализ кредитных историй и финансового поведения клиентов. Такие системы должны быть прозрачны и интерпретируемыми для регулятора. Кроме того, такие модели должны быть непредвзяты. Поскольку также эти модели работают с огромным количеством конфиденциальной информации, то важно удостовериться в отсутствии возможностей утечек этой информации.

Обнаружение мошенничества: выявление подозрительных транзакций в реальном времени, анализ поведенческих паттернов для идентификации мошенников. Робастность систем критична для эффективной борьбы с мошенничеством

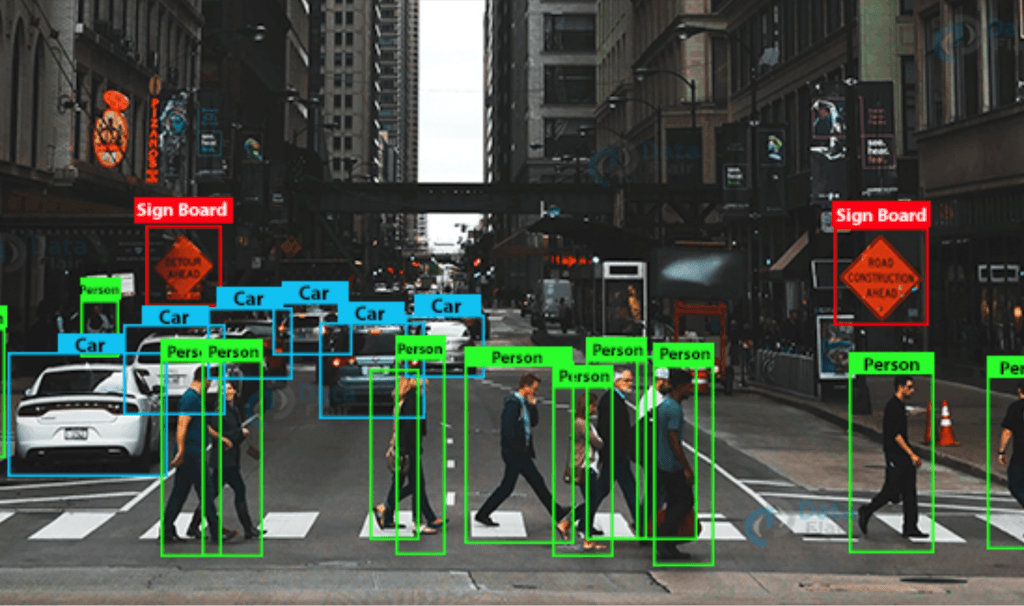

Автономные транспортные средства

В контексте АТС робастность имеет жизненно важное значение, так как транспортные средства работают в динамичных и непредсказуемых условиях. Они должны реагировать на внезапные изменения на дороге: погода, пешеходы, другие транспортные средства, дорожные работы и т.д. Неустойчивая или некорректная работа ИИ может привести к авариям или другим опасным ситуациям.

Примеры уязвимостей:

Неожиданные ситуации: автомобили могут столкнуться с ситуациями, которые не были учтены в обучении ИИ, например, с неадекватным поведением других водителей или сложными дорожными условиями.

Шум в данных: ошибки в показаниях сенсоров (камер, радаров, лидаров) или интерпретации данных могут привести к неверным решениям ИИ.

Атаки на систему: кибератаки, такие как подмена дорожных знаков, могут обмануть систему и привести к небезопасным решениям.

Для повышения робастности системы ИИ должны быть обучены на большом количестве данных, включая редкие и экстремальные сценарии, а также иметь встроенные механизмы для устойчивого поведения в случае неожиданных отклонений.

Безопасность АТС зависит от того, насколько эффективно ИИ способен предотвращать и минимизировать аварийные ситуации. АТС должны работать в среде, где любое неверное решение может иметь фатальные последствия для водителей, пассажиров и пешеходов. Это включает как предотвращение столкновений, так и способность к быстрому принятию решений в экстренных ситуациях.

Важные аспекты безопасности:

Этичность решений: В случае аварийных ситуаций ИИ должен принимать решения с минимальным риском для человеческих жизней, что ставит перед разработчиками сложные этические вопросы (например, как выбрать наименее вредный исход в аварии).

Надежность алгоритмов: Алгоритмы должны быть протестированы и верифицированы на соответствие стандартам безопасности. Здесь крайне важно учитывать интерпретируемость.

Обработка отказов: В критических случаях, когда ИИ не может адекватно оценить ситуацию (например, отказ сенсоров или сбой в алгоритме), система должна перейти в безопасное состояние или передать управление водителю.

Промышленность

Искусственный интеллект стремительно меняет облик современной промышленности, открывая новые возможности для оптимизации производства, повышения эффективности и создания инновационных продуктов. Рассмотрим основные направления применения ИИ в промышленности и проанализируем важность учета вопросов безопасности и робастности в этой сфере.

Основные области применения ИИ в промышленности:

Предиктивное обслуживание: прогнозирование поломок оборудования и снижение незапланированных простоев

Безопасность труда: мониторинг соблюдения правил техники безопасности, прогнозирование и предотвращение несчастных случаев

Контроль качества: автоматическое выявление дефектов с помощью компьютерного зрения, анализ причин возникновения брака, прогнозирование качества продукции.

Безопасность систем искусственного интеллекта в промышленности важна по следующим причинам:

Негативные экономические последствия. Сбои в работе ИИ могут вызвать простои производства и финансовые потери и могут повлиять на качество продукции и репутацию компании

Возможность кибератак. Промышленные ИИ-системы могут стать целью хакеров. Взлом систем управления производством может иметь катастрофические последствия

Необходимость в надежности и отказоустойчивости. ИИ-системы должны быть устойчивы к сбоям и ошибкам, которые могут регулярно случаться в силу труднопредсказуемых обстоятельств.

26 авг. 2024 г.